Artigo

Claude Opus 4.7 no Amazon Bedrock Não É Uma Troca Simples de Versão

TL;DR:

- Trate o Opus 4.7 no Bedrock como migração, não como upgrade rotineiro. A AWS mudou o modelo e a camada de inferência ao mesmo tempo, e a Anthropic mudou a tokenização e parte do comportamento de runtime.

- Antes do rollout, re-teste tokenização, headroom de

max_tokens, configurações de esforço, uso de ferramentas, custo por tarefa concluída, quotas, cobertura regional e qualquer diferença entre Bedrock e API direta da Anthropic.

Em 16 de abril de 2026, a AWS adicionou o Claude Opus 4.7 ao Amazon Bedrock. Para quem já opera no Bedrock, a mudança importante não é só o novo nome do modelo. A AWS mudou o modelo e a camada de inferência ao mesmo tempo, e a Anthropic mudou a tokenização e o comportamento de runtime. Trate isso como migração, não como uma troca rotineira.

O que mudou

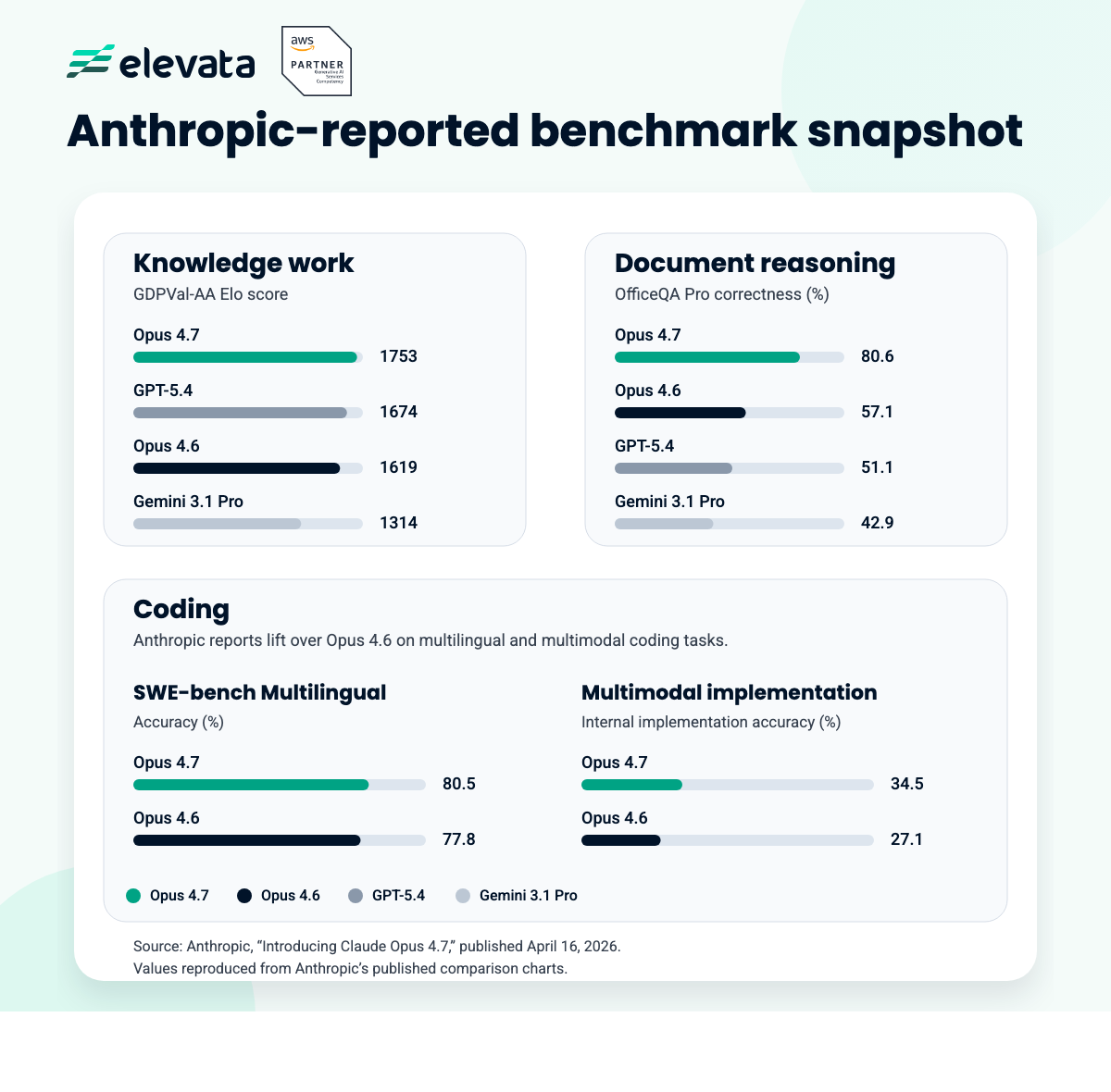

As manchetes são fáceis de resumir: melhor desempenho em engenharia de software, melhor resultado em documentos e pesquisa, mais estabilidade em contexto longo e vision em resolução mais alta. O detalhe mais importante é outro: a própria AWS avisa que as equipes podem precisar mexer em prompts e no harness de avaliação para obter o melhor resultado. Para times de produção, esse deveria ser o verdadeiro headline.

A primeira coisa a re-testar é a tokenização. A Anthropic diz que o Opus 4.7 pode usar algo entre 1,0x e 1,35x mais text tokens do que o Opus 4.6, dependendo do tipo de conteúdo. Mesmo prompt, mesmo max_tokens, headroom diferente. Se o seu sistema faz compaction de contexto, estima tokens no cliente ou já opera perto do limite, re-teste isso.

O comportamento também mudou. O Opus 4.7 tende a usar menos ferramentas e menos subagentes por padrão, e as configurações de esforço importam mais do que antes. Esforço baixo pode pensar pouco. Esforço mais alto pode recuperar mais raciocínio e mais uso de ferramentas, mas também muda custo e latência. Se seus agentes dependem de fan-out implícito, deixe esse comportamento explícito.

Se sua stack combina Bedrock e API direta da Anthropic, re-teste também o comportamento da API. A Anthropic removeu controles antigos, mudou defaults de thinking e tornou as configurações de esforço mais centrais para o resultado. Paridade de prompt não basta quando o comportamento de runtime mudou por baixo.

O custo também exige uma leitura mais cuidadosa do que o preço de tabela sugere. A Anthropic manteve o preço publicado do Opus 4.7 no mesmo nível do Opus 4.6, mas maior contagem de tokens, raciocínio mais pesado e vision em alta resolução ainda podem elevar o custo por tarefa concluída. O preço nominal ficou estável. A economia em produção pode não ficar.

O Bedrock também expõe Adaptive thinking, que ajusta o orçamento de raciocínio conforme a complexidade da requisição. Isso faz das configurações de esforço parte da avaliação, não um ajuste secundário no final.

Por que a camada do Bedrock importa

O Opus 4.7 roda sobre o novo inference engine do Bedrock, com lógica atualizada de agendamento e escalonamento. A AWS diz que isso deve melhorar disponibilidade para cargas estáveis, dar mais folga para picos rápidos e enfileirar requests sob carga em vez de rejeitá-los. A AWS também diz que prompts e respostas não ficam visíveis para operadores da Anthropic ou da própria AWS. Se privacidade, compliance ou tráfego com pico importam no seu ambiente, isso precisa entrar na avaliação.

Para testar, o Bedrock expõe o Opus 4.7 no console e no Playground, pela Anthropic Messages API, Converse API, Invoke API, AWS SDK e AWS CLI. O model ID é anthropic.claude-opus-4-7. No lançamento, a AWS o disponibilizou em N. Virginia, Tóquio, Irlanda e Estocolmo. Equipes rodando em outras regiões precisam revisar latência, residência de dados e failover antes de assumir um rollout tranquilo.

Onde ele faz mais sentido na stack

O Opus 4.7 faz mais sentido onde julgamento melhor paga o custo: planejamento, revisão, verificação multimodal, análise de documentos densos e loops agentic longos. Isso não faz dele o default certo para toda requisição.

Em muitas stacks, o melhor padrão é usar o Opus 4.7 como planner ou reviewer final e deixar modelos mais baratos cuidarem de extração, transformação e controle de fluxo. Use Opus onde ele justifica o custo.

O que re-testar antes do rollout

- Prompts e rubricas de avaliação. Melhor raciocínio normalmente muda formato de resposta, suposições e modos de falha.

- Execuções agentic de ponta a ponta. Os ganhos podem aparecer em traces longos, não em prompts isolados.

- Orçamento de tokens. Revise

max_tokens, gatilhos de compaction e qualquer estimativa de tokens feita no cliente. - Uso de ferramentas e branching. Se o modelo agora chama menos ferramentas por padrão, torne esse comportamento explícito.

- Custo em workloads reais. Refaça a conta de fluxos multimodais, cargas com muitos documentos e execuções longas.

- Suposições de plataforma. Verifique cobertura regional, quotas e diferenças de runtime entre Bedrock e API direta da Anthropic.

Faça benchmark no seu próprio workload, na região que você realmente usa e pelo caminho de API que pretende manter em produção. Compare custo por tarefa concluída, taxa de retry, latência e qualidade final. Isso vai dizer mais do que qualquer launch chart.

Relacionados

Continue lendo

Leituras relacionadas a este tema.

29/05/2026

14 min de leitura

Claude Opus 4.8: o ranking não é seu benchmark

Continuar leitura

19/05/2026

9 min de leitura

Sandbox Governado para Agentes de IA na AWS

Continuar leitura

07/05/2026

9 min de leitura

Servidor AWS MCP: acesso seguro e governado à AWS para agentes de IA

Continuar leitura

20/04/2026

4 min de leitura